使用Unimrcp和Funasr构建呼叫中心语音识别服务端

1.编译及运行unimrcp

此次使用的是unimrcp1.6版本,先下载unimrcp-deps-1.6.0以及unimrcp-1.6.0进行构建,此处不过多赘述。

2.新增funasr-recog,支持funasr识别

模块新增可参考智能客服搭建(2) - MRCP Server ASR插件开发

此步骤,主要是使用websocket去连接funasr服务端,(funasr的部署自行百度),在funasr_recog_channel_recognize创建funasr连接,在funasr_recog_recognition_complete处理funasr返回的数据,构建xml返回给freeswitch,此次vad使用的是webrtc vad。

void create_xml_output(const char *parsed_text, char *xml_output, size_t xml_output_size) {

snprintf(xml_output, xml_output_size,

"<?xml version=\"1.0\" encoding=\"utf-8\" ?>\n"

"<result>\n"

" <interpretation grammar=\"http://127.0.0.1/welcom.grxml\" confidence=\"100\">\n"

" <instance>\n"

" <speech-to-text confidence=\"100\">%s</speech-to-text>\n"

" </instance>\n"

" <input mode=\"speech\">%s</input>\n"

" </interpretation>\n"

"</result>",

parsed_text, parsed_text);

}

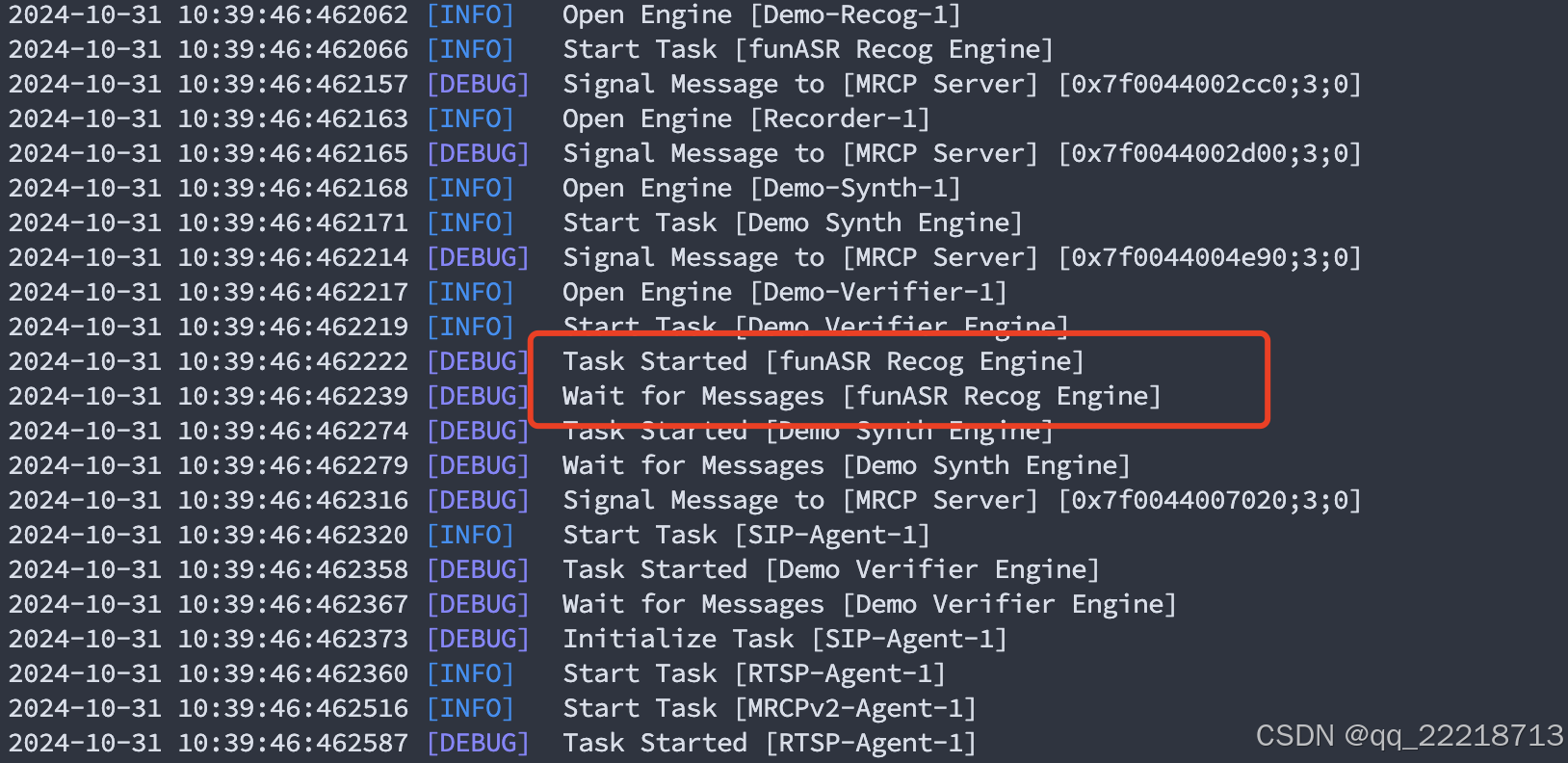

3.启动unimrcp

成功加载funasr识别模块

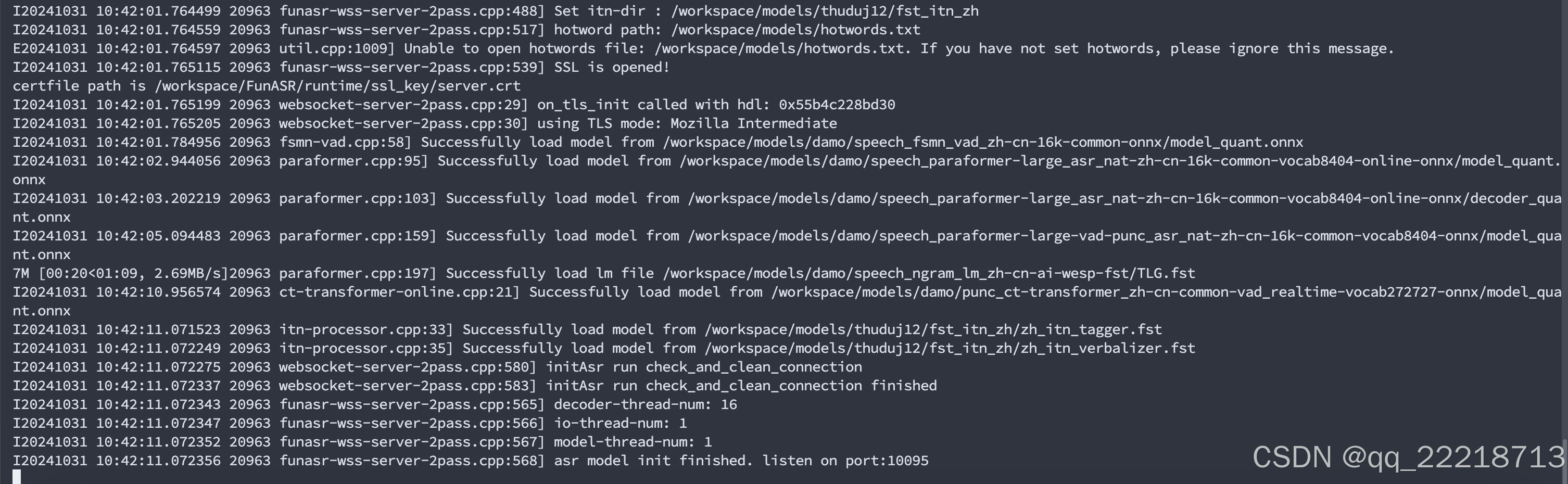

4.启动funasr

成功启动funasr

5. freeswitch呼叫测试

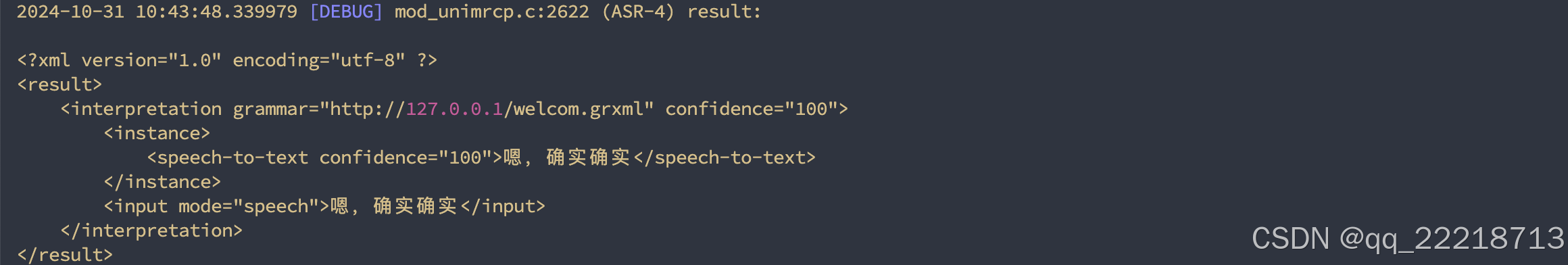

Freeswitch日志

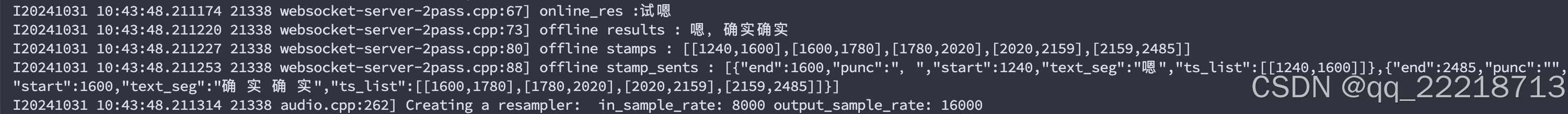

Funasr日志

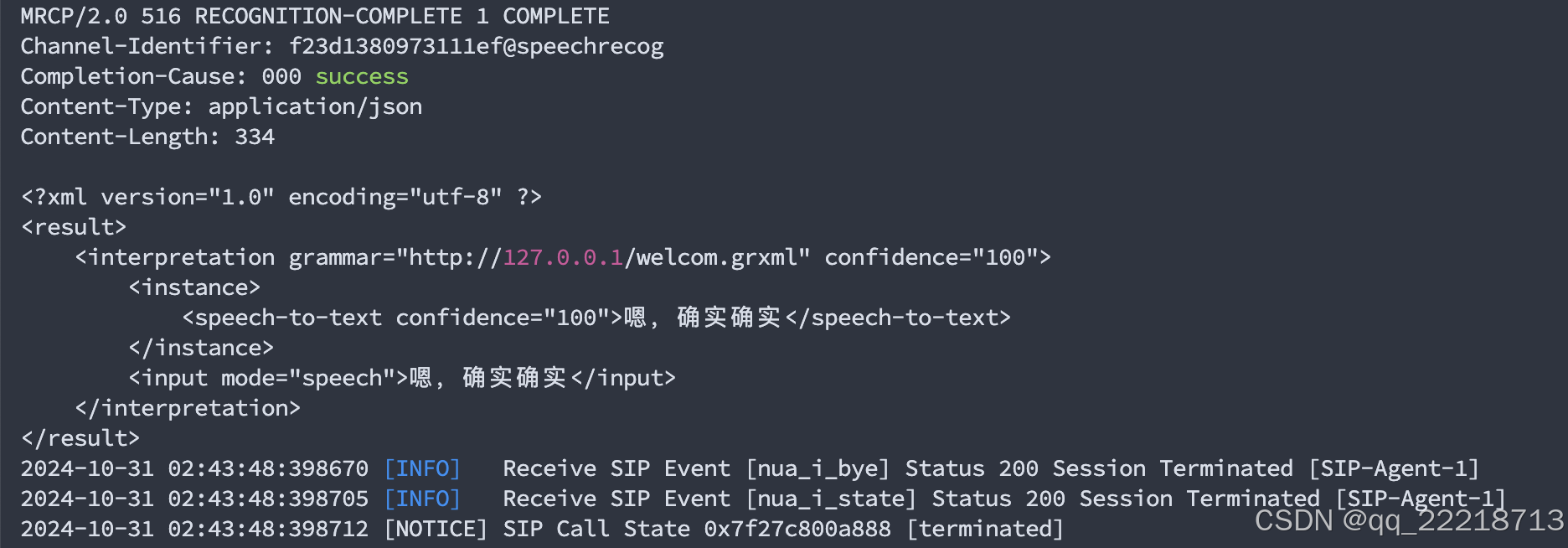

Unimrcp日志

v: wxh_assistant

转载自CSDN-专业IT技术社区

原文链接:https://blog.csdn.net/qq_22218713/article/details/143383700