Logstash-Doris日志输出本地环境搭建与操作演示

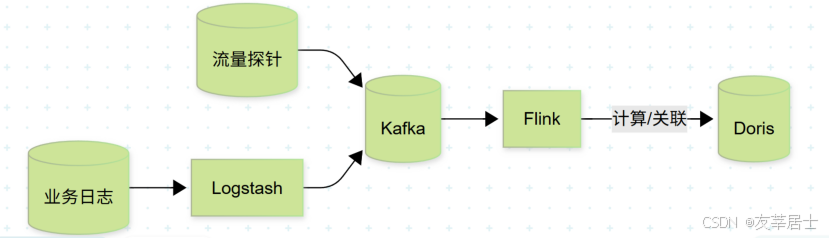

1. 整体流程

2. 步骤说明

- 本地环境搭建与操作演示从业务日志 → Logstash → Kafka → Doris,Flink → Doris 不在本文研究范围,由后续 Flink 集成进来再进一步研究部署。

- 本地环境搭建:从 192.168.1.168 服务器部署一套 Logstash,上传了几个日志文件在同一台服务器,由 Logstash 解析本地日志文件,并推送到 Kafka(也部署在 192.168.1.168),通过 Kafka 消费者组消费并存储到 Doris 数据库。

3. 部署模拟场景说明

3.1 日志文件说明

- 服务器每天产生一个

.log日志文件,Logstash 实时解析这些.log文件,并按时间顺序往 Kafka 推送。 - 日志文件格式:

log_20260225.log、log_20260226.log、log_20260227.log - Kafka 消费者消费消息并存储到 Doris 数据库,用

consumer.log记录消费接收信息日志。

3.2 库表信息

- 数据库名:demo

- 表名:kafka_to_doris

字段表结构:

| 字段名 | 字段类型 | 是否为 null | 字段备注 |

|---|---|---|---|

| id | varchar(64) | not null | 主键ID |

| log_info | text | 日志明细(json串直接存储) | |

| sys_source | varchar(32) | 系统来源 | |

| create_time | datetime | not null | 创建时间 |

3.3 其他说明

- 每天产生一个

receive_log_带日期.log的文件,Doris 日志信息按日志文件顺序保存(在哪个日志文件追加日志就保存哪一天的日志)。 - 实际生产环境上的日志也是按这种形式存储的。

- 目前的研究和配置支持服务运行期间日志的实时追加与记录,暂不支持 Logstash 在宕机恢复后自动读取宕机期间追加的日志。

3.4 主要配置文件汇总

# Logstash同步策略配置

vim /data/cross-border/logstash/pipeline/logstash.conf

# Logstash网络配置

vim /data/cross-border/logstash/config/logstash.yml

# Kafka消费者组启动脚本

touch /data/kafka-consumer/consumer_doris.sh

4. 部署步骤演示

4.1 上传并加载 Logstash 镜像

# 上传logstash.tar包至192.168.1.168服务器

# 将tar归档文件加载并导入Docker镜像

docker load < logstash.tar

4.2 创建目录并设置权限

# 创建两个文件夹,存放服务转载自CSDN-专业IT技术社区

原文链接:https://blog.csdn.net/qq_37713191/article/details/158891812