「智算X互联 AI-X OpenLab」专注智算互联产业和技术观察。最近几期里我们将从智算互联角度对NVIDIA GTC2 2026进行拆解。如感兴趣,请搜索关注「智算X互联 」公众号。

一、核心定位:AI工厂的东西向“神经末梢”

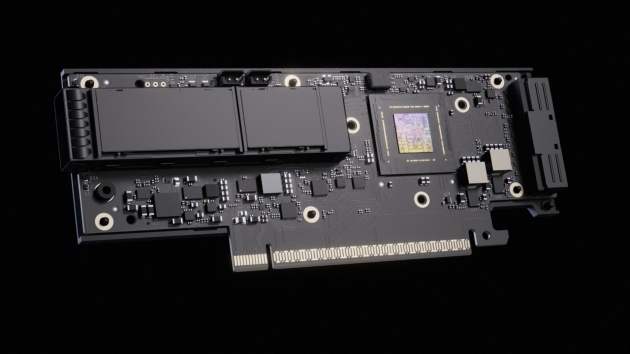

在GTC 2026发布的Vera Rubin平台中,ConnectX-9 SuperNIC扮演着关键角色——它不再是传统意义上的网卡,而是专为跨机架Scale-Out设计的AI工厂东西向神经末梢。

为什么这个定位如此重要?

- 传统AI集群的瓶颈已从计算转向通信

- 50万+加速器规模下,东西向流量(跨服务器、跨机架)成为性能杀手

- ConnectX-9正是为解决这一核心痛点而生

二、技术参数:1.6Tbps的“暴力美学”

| 参数 | 规格 | 意义 |

|---|---|---|

| 聚合带宽 | 1.6Tbps | 单卡带宽创纪录,满足下一代AI工作负载 |

| 单端口速率 | 800G XDR/800GbE | 支持InfiniBand XDR和以太网双协议 |

| 端口配置 | 32+高基数端口 | 支持大规模直接连接,减少交换层级 |

| 集成架构 | 与Spectrum-6 CPO、BlueField-4 DPU协同 | 实现端到端优化 |

关键突破:

- 架构跃迁:从ConnectX-8的双端口400G,升级为单端口800G

- 1x800G模式在处理高吞吐任务时更具优势,减少端口调度开销

三、系统级价值:让50万+加速器集群“活”起来

3.1 解决规模扩展难题

- 2层以太网平面即可扩展至50万+加速器

- 配合Spectrum-6 CPO交换机,构建微秒级尾延迟的通信平面

- 相比传统架构,token吞吐量提升数倍

3.2 成本革命

- 单token成本降至Blackwell平台的1/10

- 这对于大规模Agentic AI推理至关重要

- 使多智能体协同从概念走向工业级可行方案

3.3 安全与集成

- 后量子加密安全架构:应对未来安全威胁

- 深度集成于下一代计算平台,成为核心组件而非外设

四、技术架构深度解析

4.1 高基数端口设计

- 32+端口支持直接多目标连接

- 减少对交换机的依赖,降低延迟和成本

- 支持灵活的拓扑配置

4.2 智能卸载引擎

- 硬件卸载RoCEv2协议栈

- 支持自适应路由和拥塞控制

- 与BlueField-4 DPU协同,实现KV缓存零拷贝搬运

4.3 与Vera Rubin平台协同

Vera CPU(计算) + Rubin GPU(加速) + ConnectX-9(通信) + BlueField-4(存储/管理)

- 七芯片协同设计,形成统一内存空间

- 260TB/s机架级互联带宽

- 支撑百万token长上下文无瓶颈推理

五、对AI基础设施的启示

5.1 网络范式的转变

ConnectX-9 SuperNIC标志着AI网络从:

- 带宽堆叠 → 智能调度

- 通用互联 → AI原生互联

- 设备级优化 → 系统级协同

5.2 对开发者的意义

- 无需重写应用:兼容现有RDMA和以太网生态

- 性能透明提升:硬件自动优化通信模式

- 支持大规模Agentic AI:为多智能体系统提供通信基础

5.3 产业影响

- 加速以太网在AI后端的主导地位(文档显示份额已升至74%)

- 推动开放标准融合:支持与UEC等开放标准的互操作

- 降低AI工厂建设门槛:通过标准化互联简化部署

六、总结:为什么ConnectX-9是转折点?

ConnectX-9 SuperNIC不是简单的带宽升级,而是AI基础设施通信层的范式重构:

- 规模突破:首次让50万+加速器的2层网络成为可能

- 成本突破:将token成本降至十分之一,改变经济模型

- 架构突破:从“网卡”进化为“神经末梢”,深度融入计算体系

展望:随着1.6T以太网和CPO技术的成熟,ConnectX-9代表的智能互联架构将成为下一代AI工厂的标配。对于开发者而言,关注的不再是单卡性能,而是如何利用这种系统级协同构建更高效的AI应用。

注:本文基于GTC 2026公开资料及技术文档分析,实际产品规格以英伟达官方发布为准。ConnectX-9预计随Vera Rubin平台于2026年上市。

转载自CSDN-专业IT技术社区

原文链接:https://blog.csdn.net/u013189978/article/details/159323629